2026年1月27日上午,田纳西大学哈斯拉姆商学院亚马逊讲席教授黄庭亮应邀作客国产探花 ,在B201会议室带来题为《Optimal Liability Design for Medical AI》的精彩报告。本次报告由国产探花 李四杰教授主持,陈静副教授进行点评。

报告伊始,黄庭亮教授立足于人工智能(AI)在全球医疗机构中应用市场巨大的现实背景,指出虽然AI技术具有广阔前景,但如何有效监管AI在医疗领域的采用至关重要。政策设计的核心目标在于通过合理的机制设定,明确AI技术的应用边界,从而在医疗服务中实现“提高质量”与“降低成本”的双重目标。在此基础上,黄教授聚焦于一个具体的监管难题:在信息不对称的环境下,面对诊断水平异质性的医生,应如何设定合理的医疗责任?黄教授指出,医生诊断能力的异质性及其不可观测性,使得医疗AI时代的责任界定变得异常复杂,为监管带来了新的挑战。

随后,黄教授介绍了其研究中构建的一个巧妙的博弈模型。该模型旨在探讨社会规划者如何设计最优的医疗责任机制,以规范拥有私人质量信息的医生行为。在模型设定中,医生面临三种决策路径:采用标准治疗方案、遵循AI建议,或基于自身专业判断进行个性化治疗。黄教授特别强调,个性化治疗虽然可能带来更高收益,但也伴随着风险,其效果取决于医生自身的诊断水平。通过严谨的理论推导,黄教授深入分析了不同情境下的博弈均衡与最优策略。

黄教授的研究得出了一系列极具启发性的新颖观点。首先,研究发现,在信息不对称条件下,针对偏离标准治疗方案的医生,最优的责任机制为实行统一的责任水平。尽管医生群体存在异质性,但这种简单的政策在标准护理可靠或AI高度准确的情况下,往往能够实现完全信息下的最优结果。

其次,黄教授强调了AI准确性与最优责任之间非单调的复杂关系。与通常直觉相反,更高精度的AI并不总是意味着更宽松的责任约束。随着AI准确性的提升,最优责任水平既可能单调下降,也可能呈现“倒U型”模式。黄教授特别指出,这取决于病人病情的复杂程度:即使AI精度很高,若病人病情极其复杂,最优责任水平仍需保持高位。此外,当医生诊断能力极低时,即便AI精度较高,系统也可能不推荐盲目采用AI。

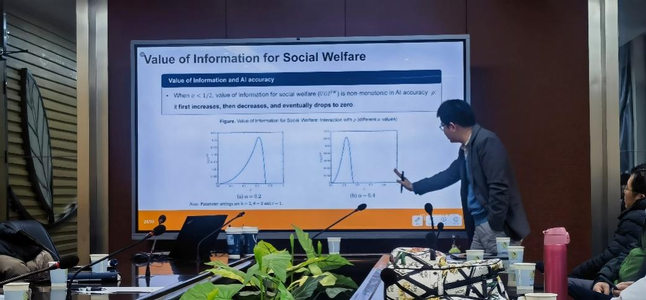

最后,黄教授进一步探讨了福利效应与信息结构的影响。研究表明,信息的价值不仅取决于AI的精度,还取决于病情的复杂程度。在AI存在的环境下,信息不对称是一把“双刃剑”。黄教授强调,更高的透明度并不必然造福所有的利益相关者,在特定情形下,消除信息不对称反而可能损害医生的利益。

报告最后,黄庭亮教授总结了研究结论,并对未来的医疗监管政策设计进行了展望。整场报告逻辑严密、见解独到,为师生们理解数字医疗时代下的责任归属、监管政策以及医生与AI的互动关系提供了坚实的理论依据与全新视角。在场师生反响热烈,并就模型假设与现实应用的结合与黄教授进行了深入讨论,本次报告圆满结束。